|

為解決上肢斷肢人士使用義肢的不便,南臺科大與奇美醫院復健部共同研發AI Armature,透過結合智慧眼鏡、邊緣運算裝置(AI BOX)與AI義肢手臂,使用者眼中的影像資訊將會傳遞至AI BOX進行分析運算,最後由AI義肢手臂自動根據物件類型轉換手勢,操作上直覺又靈敏,且透過團隊的核心技術,運算成本減少90%,準確率達98%。該產品以模組化設計,後續軟體更新與硬體維護可做獨立置換,使用成本只需要競品的1/3,預計在2024年取得上市許可… |

|

新科技的革新和應用正在改變未來醫療與照護的面貌,許多科學家也正積極嘗試機械裝置與人的行為能無縫融合(convergence)可能性。對斷肢人士來說,最理想的境界是未來能讓義肢做到人機合一,融入未來生活、並成為生活的一部份。然而,現有義肢缺乏友善且具美感的及生活上的便利性,卻一直困擾著這群使用者。未來生活、並成為生活的一部份。然而,現有義肢缺乏友善且具美感的及生活上的便利性,卻一直困擾著這群使用者。 南臺科大的一群熱血教師和奇美醫院的臨床醫師組成的團隊,看到了真實世界的需求,深入了解到斷肢人士的不便與痛苦,團隊透過彼此的專業與熱忱、為上肢截肢者開發了全臺首個人工智慧視覺輔助義肢─ AI Armature,這項AI 智慧輔具能透過佩戴智慧眼鏡追蹤使用者視角,由可攜式邊緣運算裝置(AI BOX)分析物件類型,進而控制AI 義肢手臂來完成相對應的手勢,使用者甚至能在外觀上及功能上進行客製化,讓這項科技輔具產品更具個人化特色。張萬榮教授團隊受訪時表示,耗費5 年多時間完成這項技術的開發,就是要打造「最貼近生活習慣的義肢」,實現所見即所得(What You See Is What You Get)的目標。

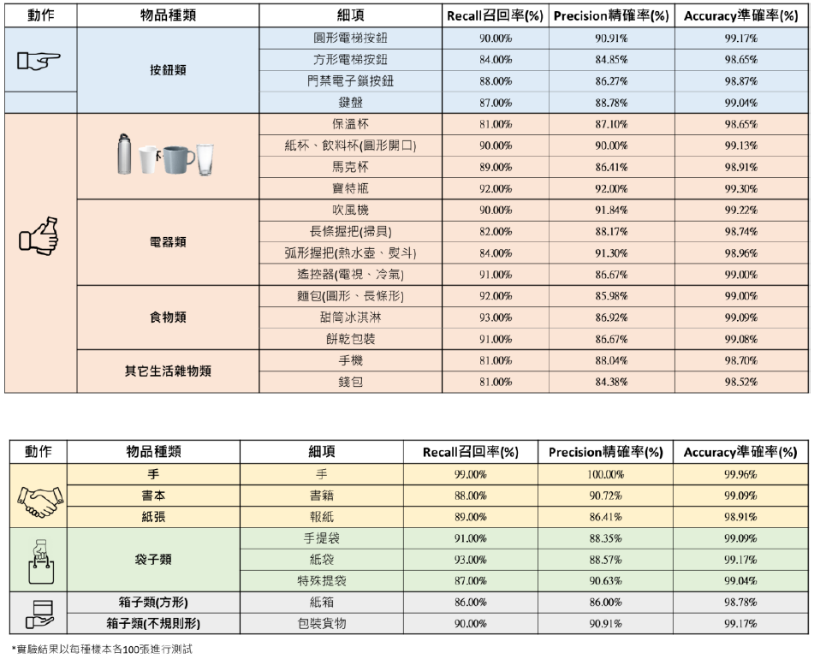

※AI Armature研發團隊:陳銘哲教授(左一)、張萬榮教授(左二)、施金波教授(左三)、歐陽昆教授(中)。(照片來源:南臺科大) AI Armature 核心技術讓義肢操作直覺又靈敏 團隊研發的AI Armature 跳脫了現有產品的功能與框架,這項技術的特色係透過智慧眼鏡來追蹤使用者第一人稱視角與與注視點位置,接著將這些影像資訊傳遞至AI 邊緣運算裝置(AI BOX),透過深度學習物件偵測技術,讓AI 義肢手臂會依據物件類型轉換指、握、微握、提、搬等五種手勢及對應力道。目前這項智慧義肢能提供的抓握力道已可達0.5-1 公斤,並能針對10種不同日常生活中常見的類型、26 種物件進行辨識並下達指令,完成直覺又靈敏的操作體驗。未來將持續擴充多模組資料庫,打造獨一無二的手臂,也可針對生活常用動作與常見物品客製手勢套餐,在使用上能更貼近每個人需求。,讓義肢能支援在更多元、複雜的情境下使用。

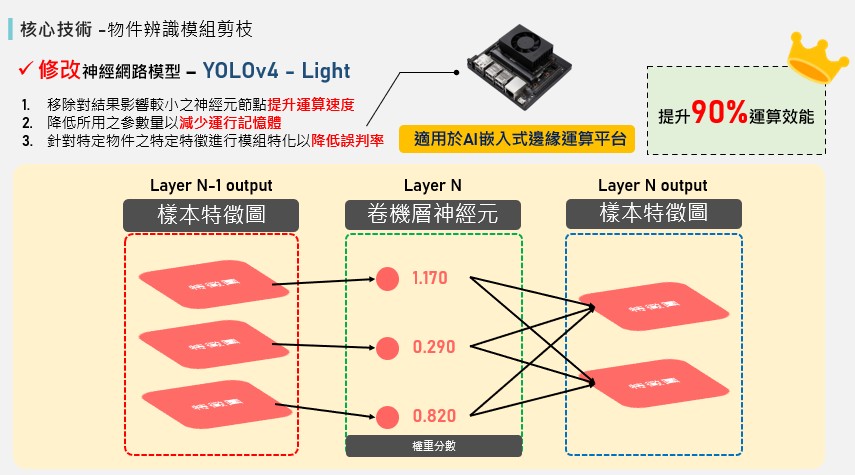

YOLOv4 模型大瘦身 減少90%運算力、保有98%準確率 談到這項技術最困難的部分,張萬榮老師提到AI Armature 的深度學習物件偵測模型係以YOLOv4 為核心,但AI BOX 的處理器與效能有其限制,讓原始YOLOv4模型在AI BOX 中可辨識的物件數量變的相當有限。團隊花費不少時間透過參數以及運算階層的調整,才將對於辨識結果影響較小的卷積神經網路階層之神經元移除,提出輕量化版本的YOLOv4 模型,相較於原始版的YOLOv4模型,整體運算效能提升90%,達到了98%準確率。

從小兒、視障到成人 幫助改善弱勢患者生活品質 在成功研發AI Armature 前,團隊已結合智慧眼鏡與物件辨識的技術,讓視障者能在行走時避開利用手杖無法有效掌握的的障礙物,如招牌、公車站牌、路樹等。另外,也特別針對上肢斷肢孩童設計功能義肢並加入更多AI 功能,這樣的開發經驗,也成為了AI Armature 成長的養分。目前該項以模組化設計的AI Armature已完成IRB 申請並進入人體臨床試驗的階段,預計在2024 年取得臺灣上市許可。這項未來產品,使用者將不必隨使用年限而更換整肢手臂,皆可支援後續軟體更新與硬體維護的獨立置換,使用成本僅需現有競品的1/3、大幅降低使用者更換義肢時的適應時間,讓智慧義肢變成生活的一部份。

※系列報導: |

| ※本文由生策中心新創幫編輯群採訪撰寫(口述:南臺科大張萬榮教授團隊 執筆:施俊宇/張家瑋)。如有引用,請確實註明出處來源。 |

Copyright © 2012 - 2025 Research Center for Biotechnology and Medicine Policy (RBMP). All Rights Reserved